来自新加坡的一个科学家团队 开发了 一种干扰自动驾驶汽车的方法,这些自动驾驶汽车使用计算机视觉来识别路标。新的 GhostStripe 技术可能对特斯拉和百度 Apollo 司机造成危险。

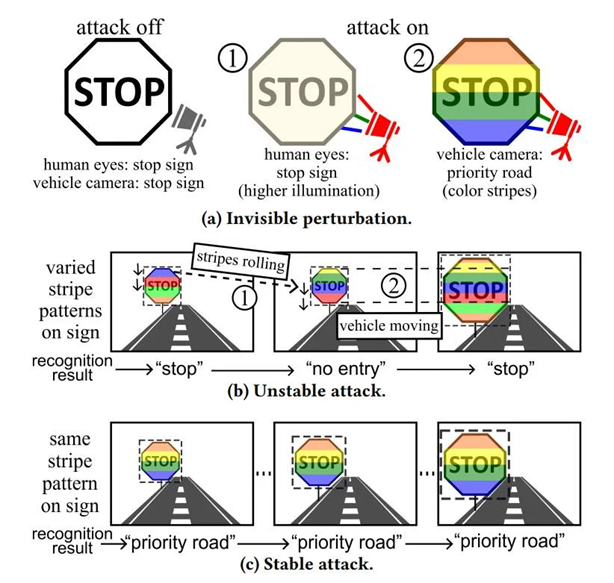

GhostStripe 背后的主要想法是使用 LED 在路标上创建灯光图案。这些图案是人眼看不见的,但它们会迷惑汽车摄像头。该攻击包括在相机触发时 LED 快速闪烁不同颜色,导致图像出现扭曲。

由于 CMOS 相机数字快门的特性,会出现失真。配备此快门的相机分阶段扫描图像,闪烁的 LED 在每个扫描阶段产生不同的阴影。结果是图像与现实不符。例如,停车标志的红色在每条扫描线上可能看起来不同。

当这样的扭曲图像进入基于深度神经网络的汽车分类器时,系统无法识别该标志并且无法对其做出正确响应。类似的攻击方法已经存在,但研究团队能够获得稳定且可重复的结果,使这种攻击在现实环境中变得实用。

研究人员开发了两种版本的攻击:

- GhostStripe1不需要访问车辆,并使用跟踪系统实时监控车辆的位置。这使您可以动态调整 LED 的闪烁,以便不识别该标志。

- GhostStripe2需要对车辆进行物理访问。在这种情况下,相机的电源线上安装了转换器,记录图像扫描的瞬间并精确控制启动时间。这使您可以攻击特定车辆并控制标志识别的结果。

该团队使用百度 Apollo 设备中使用的 Leopard Imaging AR023ZWDR 相机在真实道路上测试了该系统。测试是在停车标志、让行标志和限速标志处进行的。 GhostStripe1 的成功率为 94%,GhostStripe2 的成功率为 97%。

影响攻击有效性的因素之一是强烈的环境照明,这会降低攻击的有效性。研究人员指出,为了成功进行攻击,攻击者必须仔细选择时间和地点。

有一些对策可以减少脆弱性。例如,您可以将 CMOS 相机替换为带有传感器的数字快门,该传感器可以一次拍摄整个图像,或者随机扫描各层。额外的摄像头也可能会降低成功攻击的可能性或需要更复杂的方法。另一种措施可能是训练神经网络来识别此类攻击。

发表评论

您还未登录,请先登录。

登录